Das Traffic-Paradoxon – Wenn der Klick stirbt

Stellen Sie sich vor, Sie sitzen im monatlichen Reporting-Meeting. Auf der großen Leinwand leuchtet Ihr Google Analytics Dashboard. Die rote Linie des organischen Such-Traffics zeigt stetig nach unten. Ihr CEO runzelt die Stirn. Die SEO-Agentur schwitzt. Sie haben den Content optimiert, Backlinks aufgebaut und die Ladezeiten perfektioniert. Trotzdem bleiben die Besucher aus.

Doch dann wirft der Vertriebsleiter seine Zahlen an die Wand: Die Inbound-Leads (Anfragen) sind im gleichen Zeitraum um 25 Prozent gestiegen. Die Conversion-Rate ist exzellent. Die Neukunden wissen genau, was sie wollen, und sind extrem gut vorinformiert.

Wie ist das möglich? Woher kommen diese Käufer, wenn sie laut Analytics gar nicht auf Ihrer Webseite waren?

Willkommen in der Realität des Jahres 2026. Die Antwort auf dieses Paradoxon ist brutal, aber unausweichlich: Die klassische Customer Journey, wie wir sie kannten, ist tot. Der Klick verliert seine Macht.

Zwei Jahrzehnte lang basierte das gesamte digitale Ökosystem auf einem simplen Tauschgeschäft: Wir lieferten Google Inhalte, Google lieferte uns Klicks. Suchmaschinen waren Wegweiser, die Nutzer durch eine Liste von zehn blauen Links auf unsere Webseiten führten. In diesem Modell war der Erfolg wunderbar messbar: Klicks erzeugten Traffic, Traffic erzeugte Nutzerdaten, und Daten ermöglichten Conversions.

Doch mit der flächendeckenden Dominanz von Large Language Models (LLMs) wie ChatGPT (das 2026 allein über 815 Millionen monatlich aktive Nutzer verzeichnet), Google Gemini und Perplexity hat sich die Architektur des Internets fundamental verschoben.

Wir befinden uns in einem rasanten Übergang von einer Retrieval-basierten Ökonomie (Suchen und Abrufen) zu einer Synthese-Ökonomie (Verstehen und Antworten). Nutzer suchen nicht mehr nach Links, durch die sie sich mühsam wühlen müssen. Sie suchen nach fertigen Antworten.

Wenn eine Einkäuferin heute fragt: "Welches CRM-System ist am besten für ein mittelständisches Logistikunternehmen geeignet?", klickt sie sich nicht mehr durch fünf verschiedene Blog-Artikel. Sie fragt die KI. Die KI synthetisiert Fakten, vergleicht Funktionen und spuckt eine fertige Empfehlung aus. Die Markenbildung, die Evaluation und die Kaufentscheidung finden heute vollständig innerhalb des Chat-Interfaces statt. Das Resultat? Ein massiver Anstieg der sogenannten Zero-Click-Searches. Aktuelle Daten zeigen, dass mittlerweile über 60 bis 80 Prozent der Suchanfragen enden, ohne dass der Nutzer jemals eine externe Webseite betritt. Die KI "stiehlt" Ihren Traffic – aber sie empfiehlt (hoffentlich) Ihre Marke.

Das Problem ist: Ihr aktuelles Analytics-Setup ist auf diesem Auge völlig blind.

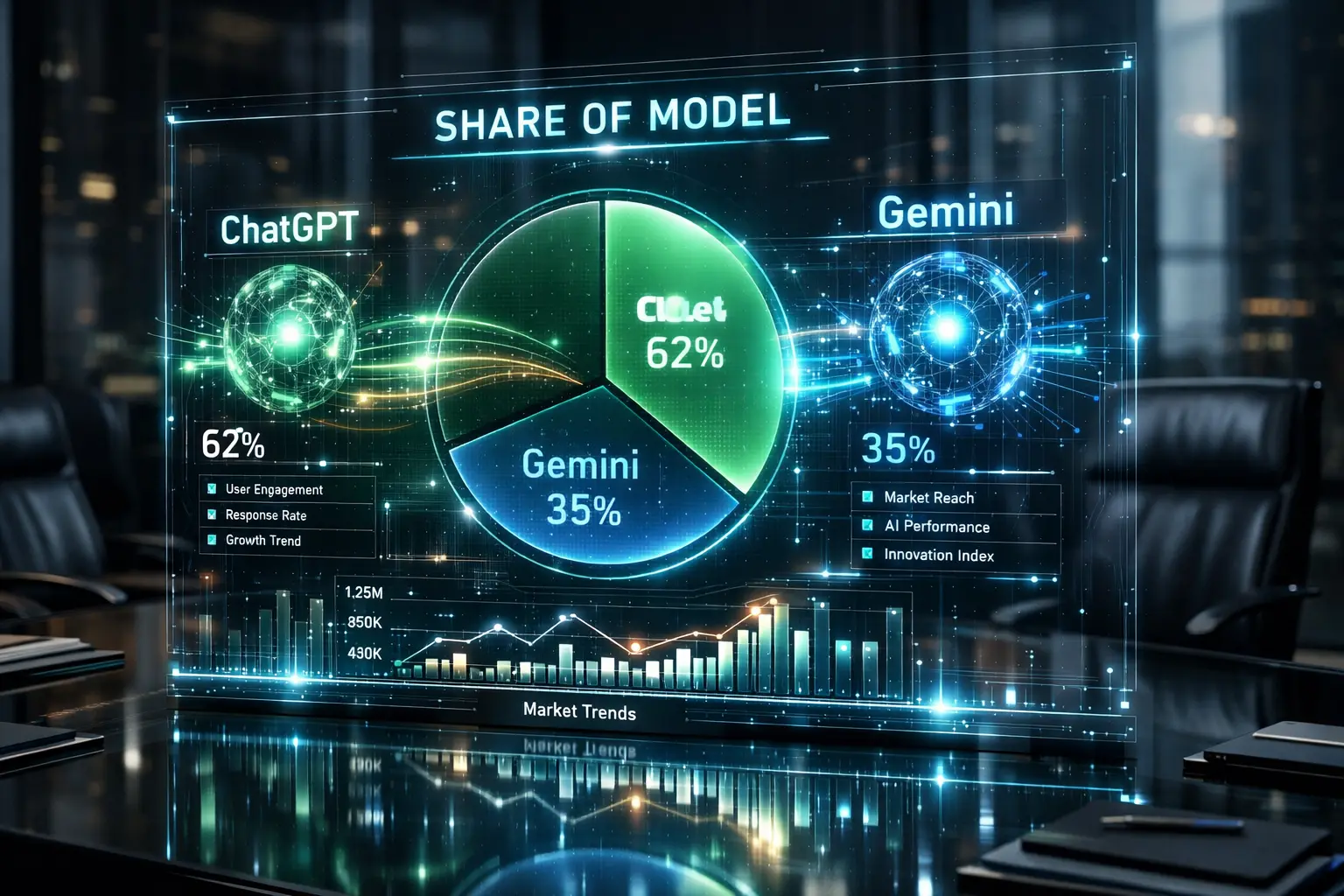

Die Geburt einer neuen KPI – Was ist "Share of Model" (SoM)?

Wenn Sie in der Vergangenheit den Erfolg Ihrer Marke im digitalen Raum messen wollten, griffen Sie vermutlich auf zwei etablierte Konzepte zurück: den Share of Voice (Wie laut trommeln wir im Vergleich zur Konkurrenz durch PR und Werbung?) oder den Share of Search (Wie oft wird unser Markenname im Vergleich zu anderen gegoogelt?).

Beide Metriken haben ein massives Problem in einer KI-gesteuerten Welt: Sie messen die Eingabe (Input) und die Lautstärke, aber nicht die maschinelle Synthese.

Wenn die Customer Journey direkt im Chatbot beginnt und endet, brauchen wir eine völlig neue Währung. Diese Währung heißt im Jahr 2026 Share of Model (SoM).

Der Share of Model beschreibt den prozentualen Anteil der Erwähnungen, die Ihre Marke von einem oder mehreren Large Language Models (LLMs) im Verhältnis zu allen Markennennungen in Ihrer spezifischen Kategorie erhält. Einfach ausgedrückt: Wenn 100 Nutzer ChatGPT fragen "Was ist die beste Projektmanagement-Software für Agenturen?", bei wie vielen dieser 100 Antworten wird Ihre Marke als Lösung empfohlen?

Der Unterschied auf einen Blick:

Share of Voice (SoV): "Wie laut ist unsere Marke auf dem Markt?" (Fokus auf Werbebudget und PR).

Share of Search: "Wie oft suchen Menschen aktiv nach uns?" (Fokus auf Suchvolumen).

Share of Model (SoM): "Wie oft und wie positiv empfehlen uns KI-Modelle, wenn Nutzer eine Lösung für ihr Problem suchen?" (Fokus auf KI-Zitationen).

Die brutale Mathematik der LLMs

Warum ist dieser Wechsel so entscheidend? Weil die Spielregeln in Sprachmodellen wie ChatGPT, Gemini oder Claude ungleich härter sind als in der klassischen Google-Suche.

Bei Google reichte es oft aus, auf Platz 5 oder 6 der ersten Seite zu ranken. Man bekam immer noch ein paar Prozentpunkte des Traffics ab. Man war im "Consideration Set" (der Auswahl des Kunden) vertreten.

KI-Modelle funktionieren jedoch radikal anders. Sie präsentieren keine zehn blauen Links. Sie fassen zusammen. Wenn ChatGPT eine Empfehlung für eine Software, ein Hotel oder einen Dienstleister ausspricht, nennt die KI in der Regel nur ein bis drei Marken.

Wenn Ihre Marke nicht zu diesen Top 3 gehört, existieren Sie für diesen Nutzer schlichtweg nicht. Sie sind unsichtbar. Laut aktuellen Branchen-Benchmarks für das Jahr 2026 (unter anderem hervorgehoben in Definitionen zum Thema Generative Engine Optimization) benötigen Marktführer heute einen Share of Model von 35 bis 40 Prozent bei zentralen Prompts, um ihre Spitzenposition zu halten und nicht von der Konkurrenz aus den KI-Antworten verdrängt zu werden.

Die Sichtbarkeit in Modellen ist also keine nette "Zusatz-Metrik" mehr für den Jahresbericht. Sie ist überlebenswichtig. Doch hier stoßen die meisten Marketing-Teams auf eine harte technologische Wand: Wie zum Teufel misst man das, wenn es keine "Google Search Console" für Künstliche Intelligenz gibt?

Das AI Citation Metrics Framework – Messen ohne Search Console

Die größte Frustration für Marketer im Jahr 2026 lässt sich in einem Satz zusammenfassen: Es gibt keine "AI Search Console". Während Google uns über zwei Jahrzehnte hinweg detaillierteste Dashboards mit exakten Impressionen, Klicks, Positionen und Click-Through-Rates (CTR) für jedes noch so kleine Keyword lieferte, geben uns OpenAI (ChatGPT), Google (Gemini) oder Perplexity: absolut nichts. Keine Dashboards. Keine Analytics. Keine Reporting-Schnittstellen. Die Modelle agieren als gigantische, undurchsichtige Blackboxen.

Wer seinen Share of Model (SoM) kennen will, muss das Messsystem selbst aufbauen. Die Lösung, die sich in führenden Agenturen etabliert hat, nennt sich das AI Citation Metrics Framework (ein Ansatz, der unter anderem von Plattformen wie Averi AI und Onely in der B2B-Praxis geprägt wurde).

Die Grundregel lautet: Methodik zuerst, Tools danach. So funktioniert das Framework in der Praxis:

Schritt 1: Das Prompt-Universum definieren Verabschieden Sie sich von der Idee, 10.000 Keywords zu tracken. KI-Modelle arbeiten nicht mit starren Keywords, sondern mit semantischen Konzepten und tiefem Kontext. Im ersten Schritt baut Ihr Team eine Test-Suite von etwa 50 bis 100 hochrelevanten Prompts (Eingaben) auf, die exakt an der Customer Journey Ihrer Käufer ausgerichtet sind. Beispiele für eine B2B-Software:

Top of Funnel: "Was sind die größten Herausforderungen bei der Lagerverwaltung 2026?"

Middle of Funnel: "Vergleiche die besten Cloud-ERP-Systeme für Logistikunternehmen."

Bottom of Funnel: "Was sind die Vor- und Nachteile von [Ihre Marke] im Vergleich zu [Konkurrent]?"

Schritt 2: Die Baseline-Abfrage (Manuell oder Automatisiert) In der Anfangsphase setzen viele Teams Praktikanten oder Werkstudenten ein, die diese 50 Prompts schlichtweg jeden Monat händisch in ChatGPT (Plus), Gemini Advanced und Perplexity eintippen und die Antworten protokollieren. Im Jahr 2026 gibt es dafür glücklicherweise spezialisierte Enterprise-Tools (wie Profound, Scrunch AI, Erlin oder Otterly AI), die diese Abfragen über API-Schnittstellen automatisieren und die Antworten systematisch auswerten.

Schritt 3: Das Scoring-Modell anwenden Nun wird ausgewertet. Wenn ChatGPT Ihre Marke auf den Prompt "Beste Cloud-ERPs" nennt, wie genau sieht diese Nennung aus? Das Framework arbeitet meist mit vier Abstufungen:

Keine Nennung: Ihre Marke existiert in der Antwort nicht.

Einfache Nennung: Sie werden in einer Aufzählung erwähnt, aber ohne tieferen Kontext.

Detaillierte Empfehlung: Die KI nennt Sie als eine der Top-Optionen und listet Ihre spezifischen Vorteile (USPs) korrekt auf.

Alleinige Empfehlung (The "One True Answer"): Die KI positioniert Ihre Marke als den absoluten Branchenstandard für dieses spezifische Problem.

Wenn Sie diese Daten monatlich aggregieren, erhalten Sie Ihren echten Share of Model. Sie sehen plötzlich schwarz auf weiß, dass ChatGPT Ihre Konkurrenz bei 60 Prozent der kaufrelevanten Prompts empfiehlt, während Ihre Marke nur bei 15 Prozent Erwähnung findet.

Sie haben das Problem nun messbar gemacht. Die Blackbox ist geknackt. Das Dashboard für den CEO steht. Doch nun folgt die eigentlich spannende Frage, die den Kern der modernen SEO-Strategie bildet: Wie verändern wir diese Zahlen?

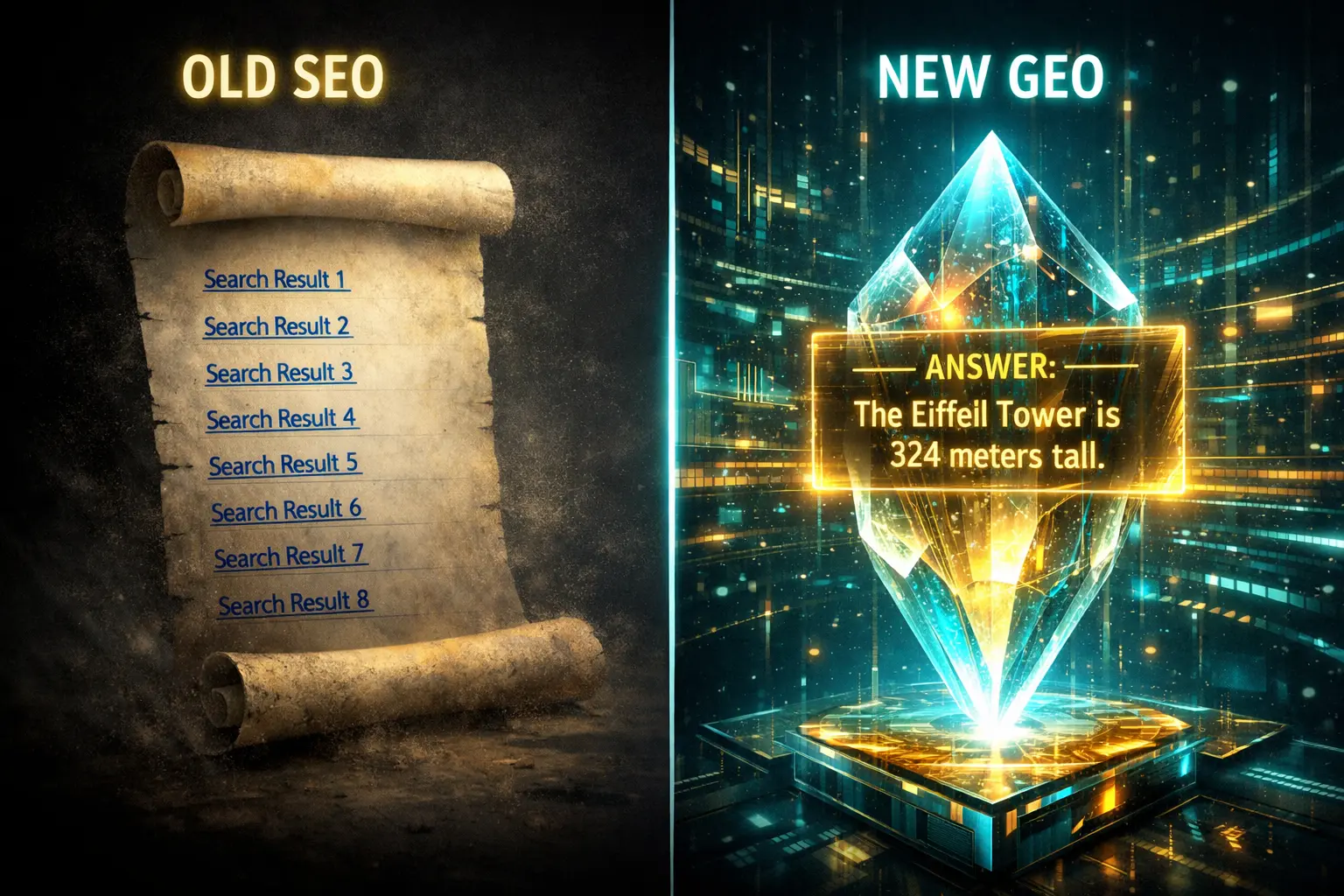

Generative Engine Optimization (GEO) – Die Kunst, die KI zu lenken

Wir haben im letzten Schritt festgestellt, dass unser Share of Model (SoM) für die wichtigsten Suchanfragen im Keller ist. Die Konkurrenz wird von ChatGPT und Gemini empfohlen, wir hingegen werden konsequent ignoriert.

Was nun? Die Antwort auf dieses Problem ist die wichtigste Marketing-Disziplin des Jahres 2026: Generative Engine Optimization (GEO).

Um zu verstehen, wie GEO funktioniert, müssen wir uns von allem verabschieden, was wir in den letzten 15 Jahren über Suchmaschinenoptimierung (SEO) gelernt haben. Bei klassischem SEO ging es darum, den Algorithmus von Google davon zu überzeugen, dass unsere Webseite die relevanteste für ein bestimmtes Keyword ist.

Sprachmodelle (LLMs) suchen jedoch nicht nach Relevanz-Signalen für Links. Sie suchen nach den besten Bausteinen für eine direkte, in sich geschlossene Antwort. Wenn eine KI eine Antwort generiert, durchforstet sie (oft in Echtzeit via RAG – Retrieval-Augmented Generation) das Netz nach Inhalten. Wenn Ihr Text nicht wie eine glasklare, unmissverständliche und hochgradig verifizierbare Antwort strukturiert ist, wird das Modell ihn ignorieren. Laut einer oft zitierten Princeton-Studie, die 2026 als Grundlage vieler GEO-Strategien dient, können Sie Ihre Sichtbarkeit in KI-Modellen um bis zu 40 Prozent steigern, wenn Sie aufhören, für Menschen zu "schwafeln", und anfangen, für Maschinen zu strukturieren.

Hier sind die drei eisernen Regeln der Generative Engine Optimization, die heute in keiner Content-Strategie fehlen dürfen:

1. Die "Answer-First" Architektur

KI-Modelle haben keine Geduld für lange, blumige Einleitungen. Wenn Ihr Blog-Artikel die Frage beantworten soll, welches CRM-System das beste ist, darf die Antwort nicht im vierten Absatz versteckt sein. Bauen Sie Ihre Inhalte nach dem Pyramiden-Prinzip auf: Die direkteste, präziseste Antwort (das Fazit) steht ganz oben, fett gedruckt. Erst danach folgen die detaillierten Erklärungen, Vergleiche und Nuancen. Die KI zieht sich diesen obersten, hochkonzentrierten Wissens-Nugget als erstes in ihren Arbeitsspeicher.

2. Autorität durch harte Daten und Zitate (Citation Optimization)

Ein LLM ist im Grunde ein gigantischer Statistik-Apparat, der furchtbare Angst davor hat, zu halluzinieren. Was gibt einer KI Sicherheit? Harte Fakten. Texte, die vage behaupten "Unser Produkt ist sehr beliebt", fallen durchs Raster. Texte, die schreiben "Laut einer Branchenumfrage von Gartner aus dem Jahr 2025 nutzen 64 % aller europäischen Logistiker unser Produkt", werden zitiert. Wenn Sie Ihre Behauptungen mit Primärdaten, validen Statistiken und echten Expertenzitaten anreichern, wird Ihr Content für die KI zu einer extrem sicheren, zitationswürdigen Quelle.

3. Semantische Vollständigkeit statt Keywords

Keyword-Stuffing (das exzessive Wiederholen von Suchbegriffen) ist endgültig ein Relikt der Steinzeit. Sprachmodelle bewerten Themen ganzheitlich (semantisch). Wenn Sie einen Text über "Künstliche Intelligenz im B2B-Vertrieb" schreiben, erwartet das Modell, dass Sie auch Konzepte wie Lead Scoring, Churn Prediction, Data Privacy und CRM-Integration behandeln. Fehlen diese semantisch verwandten Knotenpunkte, stuft die KI Ihren Text als "oberflächlich" ein und sucht sich für ihre finale Empfehlung eine andere Quelle.

Wenn Sie diese GEO-Grundlagen beherrschen, haben Sie den Fuß in der Tür. Doch hier kommt der Haken, der selbst erfahrene Agenturen zur Verzweiflung bringt: ChatGPT liest anders als Gemini. Und Perplexity liest noch einmal völlig anders.

Der 11-Prozent-Schock – Warum ChatGPT und Gemini völlig anders lesen

Wenn Marketing-Teams im Jahr 2026 ihre ersten Gehversuche mit Generative Engine Optimization (GEO) machen, stoßen sie fast immer auf dasselbe frustrierende Phänomen: Sie haben ihre Texte perfekt strukturiert, mit harten Daten angereichert und das "Answer-First"-Prinzip angewandt. Und tatsächlich: Wenn sie ChatGPT fragen, wird ihre Marke prominent empfohlen. Der Jubel ist groß. Doch als der CEO am nächsten Tag dieselbe Frage in Perplexity oder Google Gemini eintippt, taucht die Konkurrenz auf. Die eigene Marke ist spurlos verschwunden.

Wie ist das möglich? Es ist derselbe Text, dasselbe Internet, dieselbe Frage.

Die Antwort liegt in einer Zahl, die 2026 die SEO-Welt erschütterte: 11 Prozent. Eine groß angelegte Branchenstudie (die unter anderem Plattformen wie Whitehat SEO und Pixis intensiv diskutierten) analysierte über 100.000 KI-generierte Antworten und stellte fest, dass die Überschneidung der zitierten Domains zwischen ChatGPT und Perplexity bei winzigen 11 Prozent liegt.

Das ist kein Fehler im System. Es ist schlichtweg eine völlig unterschiedliche Architektur. Um Ihren Share of Model 2026 plattformübergreifend zu maximieren, müssen Sie verstehen, wie die "Großen Drei" ticken:

1. ChatGPT (Der Bibliothekar)

ChatGPT (insbesondere in der Such-Funktion) nutzt primär den Index von Microsoft Bing als Basis. Wenn das Modell das Web nach Antworten durchsucht, verlässt es sich stark auf klassische, traditionelle SEO-Signale. Eine Domain mit hoher Autorität (viele starke Backlinks) hat hier einen massiven Startvorteil. ChatGPT liebt gut strukturierte Listen (H2/H3-Tags) und zieht seine finalen Empfehlungen oft aus Übersichtsartikeln oder großen Branchen-Verzeichnissen. Wer bei Bing nicht rankt, wird von ChatGPT nur selten zitiert.

2. Perplexity (Der rasende Forscher)

Perplexity schert sich kaum um klassische Domain-Autorität. Es funktioniert über eine Echtzeit-RAG-Suche (Retrieval-Augmented Generation). Für Perplexity zählt vor allem eines: Informationsdichte und Aktualität. Die KI sucht nach Seiten, die exakt und ohne Umschweife die Frage beantworten. Während ChatGPT oft alte, etablierte Artikel bevorzugt, zitiert Perplexity gnadenlos den kleinen, unbekannten Nischen-Blog, wenn dieser die frischesten Daten, das klarste Fazit und die beste Lesbarkeit (ohne Werbe-Popups im Quelltext) bietet. Hier gewinnt semantische Präzision über Backlink-Power.

3. Google Gemini (Der Ökosystem-Herrscher)

Google Gemini sitzt auf dem mächtigsten Datenschatz der Welt: dem Google Knowledge Graph. Gemini denkt nicht in einzelnen URLs, sondern in "Entitäten" und "Themen-Autorität". Wenn Gemini entscheidet, welche Marke es empfiehlt, gleicht es ab, ob diese Marke im gesamten Netz (in News, auf Wikipedia, in YouTube-Transkripten und auf Maps) als konsistente Autorität zu diesem Thema auftritt. Gemini belohnt holistischen Content enorm. Wer nur einen guten Blog-Artikel hat, aber ansonsten online unsichtbar ist, verliert gegen Marken, die das Thema multimedial besetzen.

Die Erkenntnis aus dieser Divergenz ist für moderne Marketer Gold wert: Ihre Konkurrenten optimieren meist nur für eine Plattform und nennen das fälschlicherweise "GEO". Wenn Sie jedoch die Nuancen verstehen – Bing-Autorität für ChatGPT, radikale Fakten-Dichte für Perplexity und holistische Themen-Autorität für Gemini –, bauen Sie sich einen uneinholbaren Wettbewerbsvorteil auf.

Das alles klingt nach einem gewaltigen strategischen und operativen Aufwand. Und das bringt uns unweigerlich zu dem Punkt, an dem jedes Marketing-Meeting irgendwann endet: dem Budget.

Der ROI-Beweis – Wie man Geld misst, wenn der Traffic fehlt

Die Strategie steht, das AI Citation Metrics Framework läuft, und Ihr Share of Model 2026 klettert stetig nach oben. Doch dann kommt unweigerlich der Moment der Wahrheit. Das monatliche Meeting mit dem CFO. Er schaut auf die Zahlen, sieht die Investitionen in die Generative Engine Optimization (GEO) und stellt die eine Frage, die jeden Marketer ins Schwitzen bringt: "Wo ist der Return on Investment (ROI)? Unsere Website-Klicks sind trotzdem nicht gestiegen. Bringt uns das überhaupt Geld?"

In der alten Welt des Performance-Marketings war die Antwort einfach: Wir zeigten auf den Cost-per-Click (CPC), die Conversion-Rate und den direkten Umsatz, der über einen Tracking-Link hereinkam. In der Zero-Click-Welt von ChatGPT und Gemini funktioniert diese lineare Mathematik nicht mehr.

Wer den ROI im LLM-Zeitalter beweisen will, muss aufhören, Klicks zu zählen, und anfangen, Kausalitäten und Second-Order-Effects (Effekte zweiter Ordnung) zu messen. Führende Agenturen nutzen im Jahr 2026 dafür drei zentrale Nachweis-Methoden:

1. Der "Branded Search" Surge (Markensuch-Anstieg)

Wenn Nutzer Ihre Marke in einer KI-Antwort als Top-Empfehlung präsentiert bekommen, klicken sie nicht auf einen Link im Chatbot. Sie öffnen einen neuen Tab in Google und suchen direkt nach Ihrem Markennamen. Der verlässlichste Indikator für einen funktionierenden Share of Model ist ein zeitverzögerter, aber massiver Anstieg des organischen Branded-Traffics und der Direkteinstiege. Wenn Ihre KI-Zitationen um 20 Prozent steigen und vier Wochen später Ihre direkten Marken-Suchanfragen um 15 Prozent anziehen, haben Sie Ihre Kausalität gefunden.

2. Pipeline-Geschwindigkeit und Conversion-Qualität

Besucher, die von einer KI geschickt werden, sind keine kalten Leads mehr. Sie haben die Recherchephase (Evaluation) bereits im Chatbot abgeschlossen. Laut aktuellen GEO-Branchenreports aus dem Jahr 2026 konvertieren Nutzer, die durch AI Search auf eine Marke aufmerksam wurden, bis zu 4,4-mal besser als klassischer organischer Traffic. Messen Sie in Ihrem CRM-System, wie schnell sich Leads vom Erstkontakt zum Abschluss bewegen (Pipeline Velocity). Wenn die Verkaufszyklen plötzlich drastisch kürzer werden und die Win-Rate steigt, ist das die direkte Dividende Ihrer LLM-Präsenz.

3. Das "Zero-Click"-Attributionsmodell (Feedback-Schleifen)

Die simpelste, aber effektivste Methode, um KI-Einfluss zu beweisen: Fragen Sie Ihre Kunden. Wenn Sie ein B2B-Software-Unternehmen sind, fügen Sie Ihrem Lead-Formular zwingend ein Freitextfeld hinzu: "Wie haben Sie von uns erfahren?" Im Jahr 2026 werden Sie dort immer seltener "Google" und immer häufiger "ChatGPT hat euch als bestes Tool für Logistiker empfohlen" lesen. Wenn Sie diese qualitativen Daten aggregieren, können Sie dem CFO exakt vorrechnen, wie viel Pipeline-Wert direkt durch Sprachmodelle generiert wurde.

Wer die KI dominiert, dominiert den Markt

Das Internet hat sich gewandelt. Die Ära der zehn blauen Links und des endlosen Klick-Traffics ist vorbei. Die großen Sprachmodelle haben sich als ultimative Gatekeeper zwischen Konsumenten und Marken positioniert.

Wenn wir das Konzept des Share of Model 2026 betrachten, wird eines überdeutlich: Es ist keine Eitelkeits-Metrik für hippe Digital-Agenturen. Es ist die harte Währung der neuen Synthese-Ökonomie. Wer heute seine Content-Strategie nicht an die strengen Regeln der Generative Engine Optimization (GEO) anpasst, wer seine Texte nicht "Answer-First" strukturiert und wer auf saubere Datenzitierungen verzichtet, wird aus dem digitalen Gedächtnis der KI-Modelle gelöscht.

Der Schmerz des sinkenden Web-Traffics mag für viele Marketer im ersten Moment groß sein. Doch wer den Wandel akzeptiert, erkennt die gigantische Chance: KI-Modelle schicken Ihnen vielleicht keinen Traffic mehr – aber sie schicken Ihnen Vertrauen, Reputation und kaufbereite Kunden. Messen Sie Ihren Share of Model, optimieren Sie für die Maschine, und lassen Sie die Algorithmen für Ihre Marke arbeiten.

Häufig gestellte Fragen

Was bedeutet Share of Model 2026?+

Der Share of Model (SoM) ist die wichtigste Marketing-KPI im KI-Zeitalter. Er misst, wie oft und wie positiv Ihre Marke von Large Language Models (wie ChatGPT, Gemini oder Perplexity) als Lösung für ein Nutzerproblem empfohlen wird, im Verhältnis zu allen anderen Marken in Ihrer Branche.

Was ist Generative Engine Optimization (GEO)?+

GEO ist die Weiterentwicklung der Suchmaschinenoptimierung (SEO). Während SEO Inhalte für den Google-Algorithmus (und Klicks) optimiert, strukturiert GEO Inhalte so, dass sie von KI-Sprachmodellen optimal verstanden, als vertrauenswürdig eingestuft und in deren Antworten direkt zitiert werden (z. B. durch "Answer-First"-Strukturen und harte Statistiken).

Wie unterscheidet sich ChatGPT von Perplexity bei der Quellenauswahl?+

Die KIs nutzen völlig unterschiedliche Architekturen. Studien zeigen, dass es nur etwa 11 Prozent Überschneidung bei den zitierten Quellen gibt. ChatGPT verlässt sich stark auf den Bing-Index und klassische Domain-Autorität (Backlinks). Perplexity hingegen nutzt Echtzeit-Suchen (RAG) und belohnt vor allem extrem hohe Informationsdichte, Aktualität und direkte, werbefreie Antworten ohne Rücksicht auf die alte Domain-Stärke.

Wie messe ich den ROI von KI-Sichtbarkeit ohne Website-Klicks?+

Da KI-Modelle keinen direkten Traffic liefern, wird der ROI über indirekte Effekte (Second-Order Effects) gemessen. Dazu gehören ein zeitverzögerter Anstieg der direkten Marken-Suchanfragen (Branded Search) auf Google, drastisch kürzere Verkaufszyklen (Pipeline Velocity) sowie qualitative Lead-Befragungen ("Wie haben Sie von uns erfahren? -> Durch ChatGPT").

Das könnte Sie auch interessieren

Handverlesene Empfehlungen für Sie

GEO vs. SEO 2026: Die 7 Stufen der digitalen Sichtbarkeit

Wir schreiben das Jahr 2026. Die zehn blauen Links sind Geschichte, die „Antwortmaschine“ regiert. Während viele Marketer noch Keywords zählen, entscheiden heute KI-Modelle wie Gemini und ChatGPT über Sein oder Nichtsein im digitalen Raum. Ist die klassische Suchmaschinenoptimierung (SEO) damit am Ende? Oder erleben wir gerade ihre wichtigste Evolution hin zur Generative Engine Optimization (GEO)? In diesem tiefgehenden Artikel analysieren wir den Paradigmenwechsel in 7 Stufen – von der technischen Basis bis zum „Unfakeable“-Faktor menschlicher Authentizität. Erfahren Sie, warum sinkender Traffic manchmal steigenden Umsatz bedeutet und wie Sie Ihre Marke im Knowledge Graph der KI verankern.

Digitale Körpersprache 2026: Warum Vertrauen die neue SEO-Währung ist

Digitale Körpersprache: Das Ende der anonymen KI-Texte. Im Jahr 2026 entscheiden Nutzer in Sekunden: Ist das echte Expertise oder nur synthetische Massenware? Erfahre, warum deine „Über uns“-Seite heute wichtiger ist als deine Startseite und wie du durch verifizierte E-E-A-T-Signale zum vertrauenswürdigen Anker in der Fake-Flut wirst.

Schema Markup JSON-LD: So bringen wir der KI das Lesen bei

Ein brillanter Artikel nützt nichts, wenn die Suchmaschine ihn als unstrukturierten Zeichensalat wahrnimmt. In einer Zeit, in der KI-Agenten das Web nach Antworten durchforsten, ist JSON-LD Ihr wichtigster Dolmetscher. Verabschieden Sie sich vom Microdata-Chaos und lernen Sie, wie Sie mit dem TechArticle-Schema, verifizierten Autoren-Daten (E-E-A-T) und Video-"Key Moments" die Suchergebnisse und KI-Antworten von Google dominieren.

Content-Workflow 2026: Der Hybrid-Redakteur und die neue KI-Symbiose

Ein Text ohne menschlichen Funken ist wie Suppe ohne Salz – nahrhaft, aber völlig freudlos! Erfahren Sie, warum reine KI-Texte in modernen Redaktionen ausgedient haben. Wir werfen einen Blick in den Maschinenraum der Verlage und zeigen, wie Redakteure Künstliche Intelligenz heute als Sparringspartner fürs Brainstorming nutzen, Halluzinationen durch RAG-Pipelines verhindern und dem Text am Ende die entscheidende "Seelenmassage" verpassen.