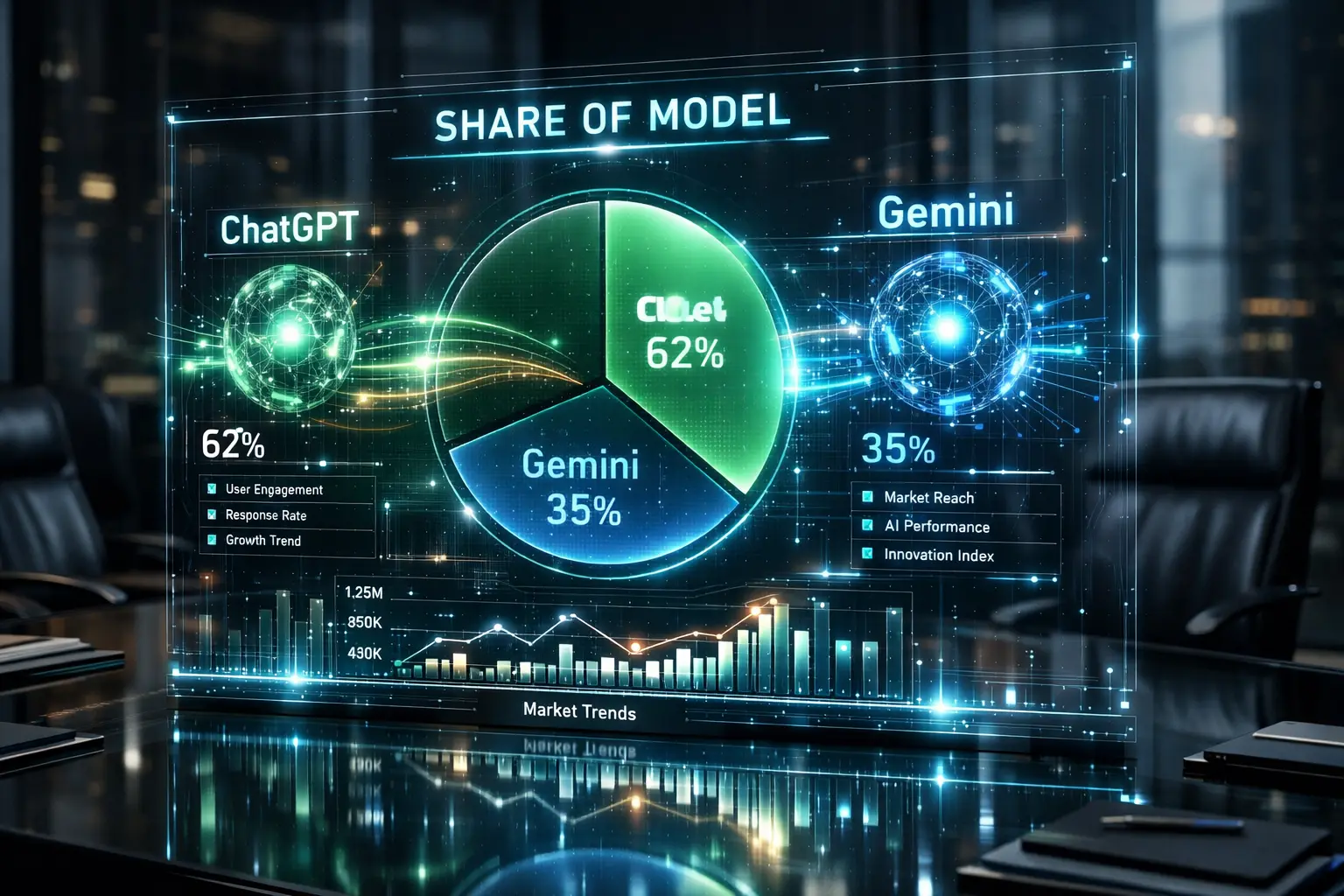

Der Megapixel-Krieg ist vorbei. Die Bildverarbeitung der Zukunft setzt auf extremen Dynamikumfang durch LOFIC-Sensoren, verzerrungsfreie Global Shutter und das revolutionäre 4D-Imaging-Radar, das autonome Systeme allwettertauglich macht. Erfahren Sie in unserem Deep-Dive, wie On-Device KI das Smartphone zum Rechenzentrum macht und warum in der professionellen Fotografie plötzlich wieder die menschliche Unvollkommenheit das höchste Qualitätsmerkmal ist.

Der Hardware-Wandel – Das Ende des Megapixel-Krieges

Erinnern Sie sich an den alten Verkäufer-Spruch? "Mehr Megapixel machen automatisch bessere Bilder." Jahrelang hat uns die Industrie genau das erzählt. Aber ganz ehrlich: Das stimmt heute einfach nicht mehr. Wenn wir uns die Bildverarbeitungstechnologie 2026 genauer ansehen, geht es um völlig andere Dinge. Die reine Auflösung ist längst nicht mehr unser Problem. Was wirklich zählt, ist der Dynamikumfang – und wie schnell der Chip die Daten direkt verarbeiten kann.

Der Trend geht ganz klar zu sogenannten "gestapelten" Bildsensoren. Der Markt dafür wächst gerade enorm. Warum? Weil die Hersteller nicht mehr einfach nur Millionen Pixel nebeneinanderquetschen. Stattdessen packen sie direkt unter die Pixel-Schicht smarte KI-Chips.

Der wohl spannendste Durchbruch der Bildverarbeitungstechnologie 2026 für Smartphones hat einen etwas sperrigen Namen: LOFIC. Das steht für Lateral Overflow Integration Capacitor. Klingt nach reinem Labor-Sprech, löst aber ein Problem, das uns alle im Alltag nervt.

Stellen Sie sich vor, Sie wollen einen wunderschönen Sonnenuntergang fotografieren. Sie halten drauf, aber der Himmel auf dem Display ist am Ende nur ein grellweißer, hässlicher Fleck. Das liegt daran, dass klassische Handy-Sensoren mit so viel Licht völlig überfordert sind. Die kleinen Pixel auf dem Sensor sind wie Eimer, die bei zu viel Licht einfach überlaufen.

Und genau hier setzt LOFIC an. Bevor der "Pixel-Eimer" überläuft, wird das restliche Licht quasi in ein kleines Nebenbecken (den Kondensator) abgeleitet und dort gespeichert. Das Ergebnis ist verrückt: Ein Dynamikumfang in den Bildern, für den man früher eine sündhaft teure Hollywood-Filmkamera gebraucht hätte.

Smartphones wie das aktuelle Xiaomi 17 Ultra mit seinem riesigen 1-Zoll-Sensor zeigen bereits, wohin die Reise geht. Diese Kameras lesen das Licht nicht mehr nur aus – sie zähmen es. Und das Beste daran? Wir brauchen diese extrem künstlichen HDR-Software-Filter nicht mehr, die unsere Bilder oft aussehen ließen wie ein schlechtes Videospiel.

Die Hardware hat endlich wieder das Steuer übernommen.

Global Shutter – Die Welt ohne Verzerrung

Haben Sie schon mal aus einem fahrenden Zug ein Foto gemacht? Oft sehen die Bäume draußen dann völlig schief aus, als würden sie umfallen. Dieser fiese Fehler nennt sich "Rolling Shutter" (rollender Verschluss). Die Kamera liest das Bild dabei Zeile für Zeile von oben nach unten aus – und weil Sie sich währenddessen bewegen, verzieht sich das Motiv wie Kaugummi.

Für uns Menschen ist das vielleicht ein lustiger Schnappschuss, den wir direkt wieder löschen. Für eine Maschine ist es eine absolute Katastrophe.

Stellen Sie sich ein autonomes Auto vor, das bei 120 km/h ein Straßenschild exakt lesen muss. Oder eine Inspektionsdrohne, die im Vorbeiflug die Rotorblätter eines Windrads auf feine Haarrisse scannt. Wenn das Bild hier auch nur minimal verzerrt ist, zieht die KI falsche Schlüsse. Genau deshalb ist der Global Shutter aktuell das absolute Wundermittel in der Bildverarbeitungstechnologie 2026.

Beim Global Shutter passiert alles auf einen Schlag. Jeder einzelne Pixel des Sensors fängt das Licht im exakt selben Bruchteil einer Millisekunde ein. Das Bild wird sprichwörtlich eingefroren, egal wie schnell sich das Objekt vor der Linse bewegt. Keine krummen Linien, kein "Wackelpudding"-Effekt mehr.

Früher musste man dafür massive Kompromisse eingehen. Global-Shutter-Kameras waren berüchtigt für schlechte Bildqualität bei wenig Licht und eher mickrige Auflösungen. Doch diese Zeiten sind vorbei. Sony, der absolute Platzhirsch auf dem Sensormarkt, verschiebt hier gerade gewaltig die Grenzen. Mit neuen Chips wie dem IMX928 bringen sie riesige Global-Shutter-Sensoren auf den Markt, die teils über 100 Megapixel knacken.

Was das für die Praxis heißt? Eine rasende Produktionsstraße in einer Fabrik kann jetzt in Echtzeit und mit extremer Schärfe überwacht werden. Die Kamera-Hardware muss nicht mehr schätzen oder per Software begradigen, was sie da gerade im Vorbeiflug gesehen hat. Sie liefert dem KI-Gehirn dahinter ein absolut fehlerfreies, geometrisch perfektes Abbild der Realität.

4D-Imaging-Radar – Der LiDAR-Killer?

Kameras sind eine feine Sache – solange die Sonne scheint oder die Straßenlaterne leuchtet. Aber was passiert mit einem autonomen Auto, wenn plötzlich dichter Nebel aufzieht? Oder wenn ein Schneesturm die Sicht auf null reduziert? Genau dann sind normale Linsen und selbst extrem teure Laserscanner (LiDAR) oft völlig blind, weil Lichtstrahlen in den Wassertropfen einfach stecken bleiben.

Hier kommt der absolute Gamechanger der Bildverarbeitungstechnologie 2026 ins Spiel: das 4D-Imaging-Radar.

Bisher kannten wir Radar im Auto vor allem als simplen Abstandswarner für den Tempomat. Das System wusste grob: "Achtung, da vorne ist ein Hindernis." Aber ob das nun ein großes Straßenschild, ein Baum oder ein stehendes Auto war, ließ sich auf dem Bildschirm kaum erkennen.

Das neue 4D-Radar ändert das jetzt komplett. Es feuert unzählige Radiowellen ab und erstellt eine so dichte Punktwolke der Umgebung, dass diese fast wie ein echtes, räumliches Kamerabild aussieht. Und der Clou dabei? Radiowellen interessieren sich überhaupt nicht für schlechtes Wetter oder blendendes Gegenlicht. Sie gehen einfach hindurch.

Aber warum eigentlich "4D"? Die vierte Dimension ist der wahre Zaubertrick: Es ist die direkte Messung der Geschwindigkeit (der sogenannte Doppler-Effekt).

Stellen Sie sich vor, ein Kind tritt im strömenden Regen hinter einem parkenden Lieferwagen auf die Straße. Das 4D-Radar erkennt nicht nur, dass da etwas ist. Es misst in Echtzeit die feinen Mikrobewegungen der Beine. Das System "weiß" also sofort, dass sich dort ein Mensch bewegt und wie schnell er ist – noch bevor eine normale Kamera die Umrisse überhaupt erahnen könnte.

Kein Wunder also, dass die Industrie gerade massiv umdenkt. Ob autonome Lieferdrohnen, smarte Züge oder Industrieroboter: Immer mehr Hersteller werfen das empfindliche LiDAR von Bord und setzen stattdessen auf das 4D-Radar. Denn eine Maschine, die unsere Straßen sicher machen soll, darf bei schlechtem Wetter nicht einfach die Augen zumachen.

Die Gegenbewegung – Warum Perfektion 2026 out ist

Wir haben in den letzten Teilen viel über absolute Präzision gesprochen. Wir bauen Kamerasensoren, die nie wieder überbelichten, und Radarsysteme, die blind durch dichten Nebel navigieren. Wir haben Maschinen erschaffen, die die Realität fehlerfreier erfassen als das menschliche Auge. Und wissen Sie, was jetzt passiert? Die Leute haben die Nase voll davon.

Wenn wir uns die Consumer-Trends in der Fotografie für das Jahr 2026 ansehen, erleben wir einen massiven kulturellen Rückschlag. Die Software-Firma Aftershoot hat vor Kurzem über 700 professionelle Fotografen befragt. Das eindeutige Leitmotiv für dieses Jahr lautet: "Emotion over perfect" – Gefühl schlägt Perfektion.

Wie kommt das? Ganz einfach: Künstliche Intelligenz hat die Perfektion entwertet.

Noch vor ein paar Jahren haben wir gestaunt, wenn ein Foto gestochen scharf, rauschfrei und makellos ausgeleuchtet war. Heute sehen wir so ein Bild und denken sofort: "Das hat doch ein Algorithmus generiert." Ein Porträt ohne Poren, ein Himmel mit dramatischen, aber völlig glattgebügelten Wolken – all das wirkt im Jahr 2026 auf uns oft steril, austauschbar und vor allem unecht.

Die neue Währung in der digitalen Bildwelt heißt Authentizität. Kunden buchen Hochzeits- oder Reportagefotografen nicht mehr für das technisch einwandfreie Bild. Sie wollen den Moment spüren. Und das bedeutet ganz konkret: Eine leichte Bewegungsunschärfe darf sein, weil jemand gerade herzhaft gelacht hat. Deutlich sichtbares Bildrauschen (Grain) ist wieder extrem beliebt. Selbst ein leicht verfehlter Fokus wird nicht mehr sofort in den Papierkorb verschoben.

Diese kleinen, menschlichen "Fehler" sind heute so etwas wie ein Echtheitszertifikat. Sie beweisen dem Betrachter, dass ein Mensch in einer echten, chaotischen Situation auf den Auslöser gedrückt hat.

Es entbehrt nicht einer gewissen Ironie: Da sitzen Tausende von brillanten Ingenieuren bei Herstellern wie Sony oder Xiaomi in den Laboren. Sie investieren Milliarden, um den Dynamikumfang zu maximieren und das kleinste Bildrauschen aus den Linsen zu verbannen. Und kaum halten wir das fertige, technische Meisterwerk in den Händen, laden wir uns als Erstes eine App herunter, die unserem Foto künstliche Filmkörnung, alte Vintage-Farben und Unschärfe verpasst.

Wir bringen unseren Maschinen zwar bei, die Welt perfekt zu sehen. Aber wir wollen auf keinen Fall, dass unsere Erinnerungen so aussehen, als kämen sie von einer Maschine.

Der Agent am Mischpult – Wenn Software aufs Wort hört

Erinnern Sie sich noch an Ihre ersten Versuche in Photoshop oder Lightroom? Die Oberfläche glich dem Cockpit eines Flugzeugs. Hunderte Regler, versteckte Untermenüs, Ebenenmasken und kryptische Tastenkombinationen, die man sich mühsam ins Muskelgedächtnis prügeln musste. Wer ein Bild professionell bearbeiten wollte, brauchte vor allem eines: sehr viel Zeit.

Wenn wir uns die Bildverarbeitungstechnologie 2026 auf der Software-Seite ansehen, ist von diesem alten Handwerk nicht mehr viel übrig geblieben. Wir bedienen die Software nicht mehr – wir delegieren an sie.

Der größte Paukenschlag kam kürzlich von Adobe. Mit den neuesten Updates für Photoshop und die Firefly-Engine hat das Unternehmen ein Feature eingeführt, das unseren Arbeitsalltag komplett auf den Kopf stellt: Voice Control für den KI-Assistenten.

Statt mühsam mit dem Lasso-Werkzeug stundenlang fliegende Haare freizustellen oder ewig nach dem perfekten Farblook zu suchen, sprechen Fotografen heute einfach mit ihrem Rechner. Sie sagen: "Entferne die störende Stromleitung im Hintergrund, wärme das Licht auf die goldene Stunde an und leg mir eine leichte, analoge Körnung über das Bild." Die Software führt das in Sekundenschnelle aus – und zwar nicht als platten Filter, sondern als saubere, zerstörungsfreie Einstellungsebenen (wie die neuen Clarity-, Dehaze- und Grain-Layer).

Das Faszinierende daran: Die KI versteht den fotografischen Kontext. Sie weiß durch ihr Training auf Millionen von Referenzbildern exakt, was "cineastisch", "Moody" oder "High-Key" auf der Ebene der reinen Pixel-Mathematik bedeutet. Und wer gar keine Desktop-Software mehr öffnen will, kann Adobe Express und Photoshop mittlerweile sogar direkt aus dem Chat-Fenster von ChatGPT heraus ansteuern.

Durch diese rasante Entwicklung der Bildverarbeitungstechnologie 2026 wandelt sich das Berufsbild massiv. Der Fotograf oder Designer wird in der Postproduktion immer weniger zum handwerklichen "Pixel-Schubser" und immer mehr zum "Art Director". Sie geben die kreative Vision verbal vor, die Maschine erledigt die Fleißarbeit, und Sie übernehmen am Ende nur noch die Qualitätskontrolle.

Die Software ist nicht länger nur ein stummer Werkzeugkasten. Sie ist ein intelligenter Co-Pilot, der zuhört.

Die Silicon-Revolution – Warum die Cloud ausgedient hat

Wenn wir über Kameras sprechen, die mit LOFIC-Sensoren die grelle Sonne bändigen, oder über Software, die auf Zuruf den Hintergrund austauscht, übersehen wir oft den eigentlichen Helden dieser Geschichte. Den heimlichen Arbeiter im Maschinenraum: den Prozessor.

Noch vor ein paar Jahren war der Ablauf bei aufwendigen KI-Bildern ziemlich ungeschickt. Sie haben auf den Auslöser gedrückt, das Smartphone hat die rohen Daten in die Cloud geschickt, dort haben riesige Serverfarmen gerechnet und das fertige Bild wieder zurück aufs Handy geschickt. Das dauerte, saugte das Datenvolumen leer, kostete Akku und bescherte Datenschützern regelmäßig graue Haare.

Im Jahr 2026 läuft das völlig anders. Die Industrie hat die Rechenpower einfach direkt ins Telefon verfrachtet. Das Zauberwort dafür lautet On-Device KI.

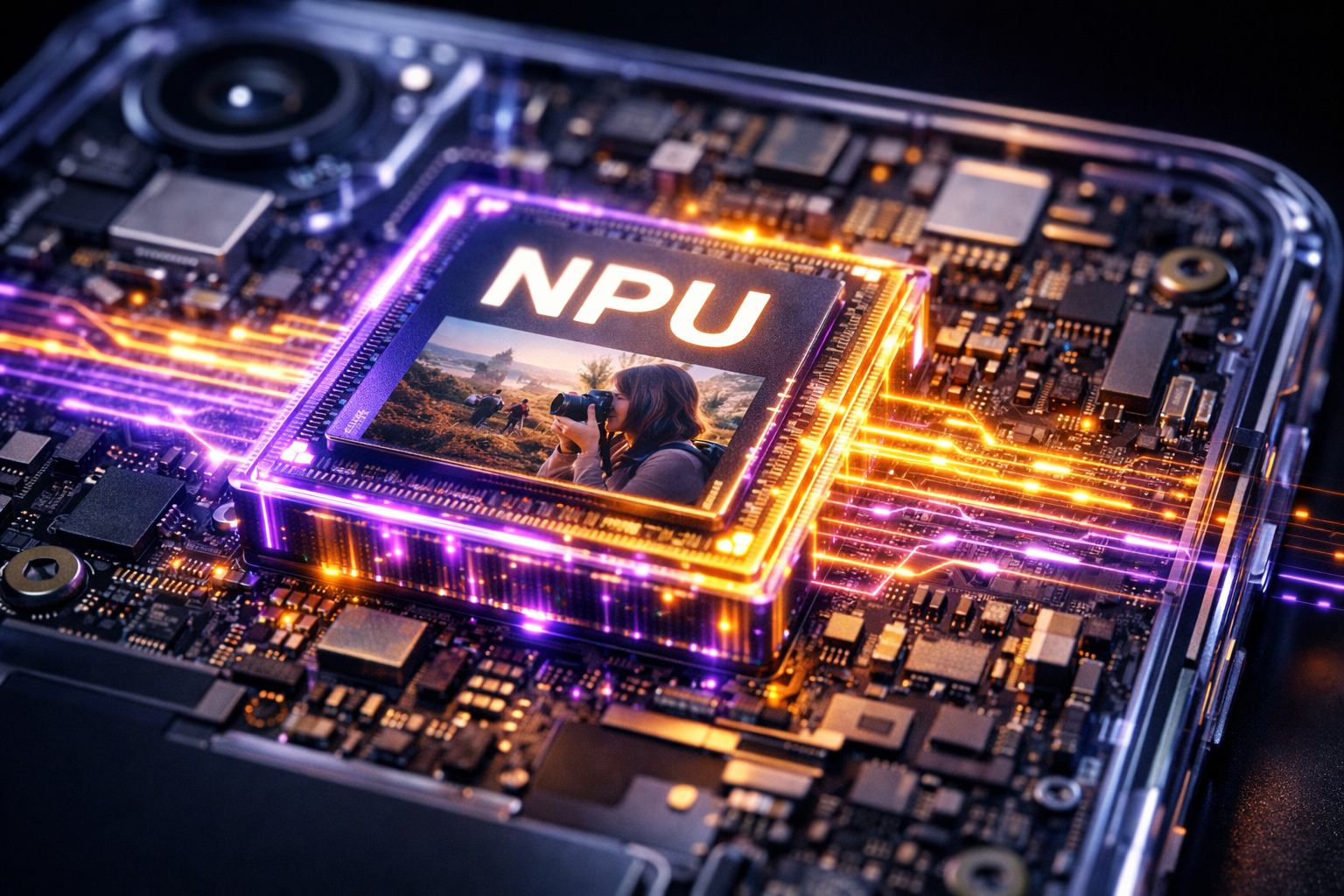

Möglich machen das völlig neu aufgebaute Mobilprozessoren, wie etwa die neueste Snapdragon-Generation. Diese Chips setzen nicht mehr nur auf die klassische CPU (für allgemeine Aufgaben), sondern haben gigantische NPUs (Neural Processing Units) verbaut.

Stellen Sie sich eine NPU wie einen hochspezialisierten Inselbegabten vor. Sie kann keine normalen Computerprogramme ausführen, aber wenn es darum geht, die gigantischen Mathe-Aufgaben von Künstlicher Intelligenz zu lösen, ist sie rasend schnell und extrem stromsparend.

Was das für Ihre Fotos bedeutet? Wahnsinnig viel. Wenn Sie heute mit einem Top-Smartphone ein Porträt schießen, passiert innerhalb von wenigen Millisekunden etwas, das man "semantische Segmentierung" nennt. Die NPU zerlegt das Bild in Echtzeit in seine Einzelteile. Sie erkennt: "Aha, das ist der Himmel, das ist ein Gesicht, das ist eine Jacke und das da hinten ist ein Baum."

Weil das alles lokal auf dem Chip passiert, optimiert die Kamera diese Bereiche völlig unabhängig voneinander – und zwar während Sie abdrücken. Das Gesicht wird sanft aufgehellt, das Blau des Himmels wird gerettet, und der Baum im Hintergrund bekommt eine weiche Unschärfe.

Wir tragen heute buchstäblich kleine KI-Rechenzentren in unseren Hosentaschen. Sie fotografieren nicht einfach nur die Realität, sie setzen das Licht beim Auslösen mathematisch völlig neu zusammen – ganz ohne Internetverbindung.

Zusammenfassung – Die Symbiose aus Sensor und Algorithmus

Wenn wir all die Puzzleteile zusammenlegen, über die wir in dieser Serie gesprochen haben, ergibt sich ein faszinierendes Bild.

Auf der einen Seite hat die Bildverarbeitungstechnologie 2026 die physikalischen Grenzen des Sehens einfach ausradiert. Wir haben Sensoren, die dank LOFIC direkt in die grelle Sonne schauen können, ohne blind zu werden. Wir frieren mit riesigen Global-Shutter-Chips die Zeit ein, ohne dass sich das Bild verbiegt. Und wo Kameras im Nebel aufgeben, schalten Maschinen einfach ihr 4D-Imaging-Radar ein und sehen trotzdem alles. Das "Erfassen" (Sensing) war noch nie so extrem mächtig wie heute.

Auf der anderen Seite erleben wir eine irre Rechenleistung im Hintergrund. Die kleinen KI-Gehirne (NPUs) in unseren Smartphones reparieren unsere Bilder schon während wir den Auslöser drücken. Und wenn wir doch mal an den Schreibtisch müssen, rufen wir unserer Software einfach zu, was sie ändern soll. Das "Verarbeiten" (Computing) ist zur unsichtbaren Magie geworden.

Aber wissen Sie, was die eigentlich wichtigste Erkenntnis aus all dem ist? Wir beten die Technik nicht mehr blind an. Nachdem uns die Künstliche Intelligenz gezeigt hat, dass sie per Knopfdruck hyper-realistische, völlig fehlerfreie Bilder ausspucken kann, haben wir den Wert des Unperfekten wiederentdeckt. Wir nutzen die modernste Hardware der Weltgeschichte, um echte, manchmal leicht unscharfe und körnige menschliche Momente festzuhalten. Weil wir am Ende des Tages wissen wollen, was wahr ist – und nicht, was ein Algorithmus errechnet hat.

Für die Industrie, vom selbstfahrenden Auto bis zur Qualitätskontrolle, bedeutet all das absolute Sicherheit. Für uns Fotografen, Kreative und ganz normale Smartphone-Nutzer bedeutet es jedoch etwas viel Besseres: ultimative Freiheit. Die Technik nimmt uns endlich die lästige Handwerksarbeit ab. Sie zwingt uns, wieder das zu werden, was wir im Kern sind: Geschichtenerzähler.

Die Maschinen haben das Sehen gelernt. Jetzt liegt es an uns zu entscheiden, worauf wir unseren Fokus richten.

Häufig gestellte Fragen

Was ist ein LOFIC-Sensor und warum ist er so wichtig?+

LOFIC (Lateral Overflow Integration Capacitor) ist eine Sensortechnologie, die das Problem überbelichteter (ausgebrannter) Bildbereiche auf Hardware-Ebene löst. Bevor ein Pixel auf dem Sensor durch zu viel Licht "überläuft", wird die überschüssige Ladung in einen benachbarten Kondensator abgeleitet. Das Resultat ist ein gigantischer Dynamikumfang in einer einzigen Aufnahme – ganz ohne künstlich wirkende HDR-Software-Filter.

Warum gilt 4D-Imaging-Radar als der "LiDAR-Killer"?+

Herkömmliche Kameras und auch Laser-basierte LiDAR-Systeme haben ein großes Problem: Sie werden bei dichtem Nebel, starkem Regen oder Schnee oft "blind". Das 4D-Imaging-Radar arbeitet mit Radiowellen und ist absolut wetterunabhängig. Es erfasst nicht nur die 3D-Position von Objekten, sondern misst als vierte Dimension (via Doppler-Effekt) in Echtzeit die exakte Eigengeschwindigkeit jedes erfassten Punktes.

Was versteht man unter "On-Device KI" in der Bildverarbeitung?+

Bisher mussten Bilder oft in die Cloud geladen werden, damit große Serverfarmen komplexe KI-Berechnungen durchführen konnten. Im Jahr 2026 haben mobile Prozessoren (wie moderne Snapdragons) gigantische "NPUs" (Neural Processing Units) integriert. Diese Chips verarbeiten neuronale Netzwerke extrem effizient direkt auf dem Gerät. Das spart Zeit (Latenz), schont das Datenvolumen und garantiert höchsten Datenschutz.

Warum geht der Fotografie-Trend 2026 weg von der Perfektion?+

Seit generative KI in der Lage ist, auf Knopfdruck makellose, hyper-realistische Bilder zu generieren, wirkt technische Perfektion auf den Betrachter oft steril und künstlich. Die Gegenbewegung lautet "Emotion over perfect". Fotografen und Kunden suchen bewusst nach dem Echten: Sichtbare Filmkörnung, leichte Unschärfe und unretuschierte Emotionen gelten heute als Beweis für menschliche Authentizität.

Wofür wird ein "Global Shutter" benötigt?+

Der klassische "Rolling Shutter" liest einen Sensor zeilenweise aus, was bei sehr schnellen Bewegungen (z.B. Rotorblätter oder Autos) zu starken Verzerrungen führt (Jello-Effekt). Ein Global Shutter belichtet und liest alle Pixel exakt im selben Bruchteil einer Millisekunde aus. Das Bild wird verzerrungsfrei eingefroren – eine absolute Grundvoraussetzung für das maschinelle Sehen in der Hochgeschwindigkeitsindustrie und Robotik.

Das könnte Sie auch interessieren

Handverlesene Empfehlungen für Sie

Festkörperbatterien 2026: Das Ende der Reichweitenangst

Reichweitenangst? Lade-Frust im Winter? Vergessen Sie es! Erfahren Sie, wie der Automobilgigant Dongfeng die E-Mobilität im Jahr 2026 komplett auf den Kopf stellt. Wir werfen einen Blick in das Innere von Festkörperbatterien mit einer absurden Energiedichte von 350 Wh/kg und erklären, warum Autos mit 1200-Volt-Architektur und vier Radnabenmotoren den klassischen Verbrenner endgültig ins Museum befördern.

Web Accessibility: Barrierefreiheit als SEO- und UX-Booster

Vergessen Sie Barrierefreiheit als reine Pflichtübung für Behörden! Erfahren Sie, warum inklusives Design im Jahr 2026 über Ihr SEO-Ranking und Ihre Conversion-Rate entscheidet. Wir lüften das Geheimnis des "Curb-Cut-Effekts" und zeigen Ihnen, warum semantisches HTML und präzise ARIA-Labels nicht nur blinden Nutzern helfen, sondern Ihre Webseite für Google-Bots und KI-Agenten zum absoluten Favoriten machen. Raus aus der "Div-Suppe", rein in die digitale Empathie!

Custom Mechanical Keyboards 2026: Das Klicken der Produktivität

Schluss mit flachen, klappernden Laptop-Tasten! Entdecken Sie, warum Programmierer, Gamer und Vielschreiber im Jahr 2026 massenhaft zu mechanischen Custom-Tastaturen wechseln. Wir erklären den Unterschied zwischen Linears, Tactiles und den neuen magnetischen Hall-Effect-Switches. Erfahren Sie in unserem Einsteiger-Guide, was ein Gasket Mount ist, warum Keycaps aus PBT (oder gar Walnussholz) Ihre Ergonomie retten und wie simples Maler-Kreppband Ihre Tastatur wie fallende Regentropfen klingen lässt.